Manchmal wird mir als Musikliebhaber übel. Nämlich immer dann, wenn irgendwelche Werbefuzzis einen meiner Lieblingssong verwursten. Rick James‘ „Superfreak“ kann ich schlicht nicht mehr hören, seit ein Vergleichsportal es zu seinem Indikativ gemacht hat. Und weil sich Fernsehwerbung fast nur noch an Menschen meiner Generation (Ü60+) wendet, vergehen sich die Reklamemacher zunehmend am Liedgut der Siebziger- und Achtzigerjahre. Aber: Manchmal ist einem TV-Spot eine Musik hinterlegt, die ich nicht kenne, von der ich aber wissen möchte, wie sie heißt. Aber das ist nicht die einzige Herausforderung.

Noch wichtiger: Zwar werden im Abspann von Spielfilmen und Serien die enthaltenen Songs gelistet, aber entweder läuft die Info zu schnell durch, oder die Schrift ist zu klein. Und dann sind da noch die DJs in den Clubs und Bars und die Radiosender, die nicht ansagen, was sie spielen. Kurz: Es gibt so viele Situationen, in denen ich gern wüsste, wie der Song heißt, den ich gerade höre.

Als 2002 Shazam startete, war ich schon ziemlich happy. Ich konnte auf meinem Handy die Kurzwahl 2580 tippen und bekam als Antwort per SMS den Titel des Songs, der gerade lief. Schon 2008 wurde daraus eine App fürs iPhone – eine der ersten im App-Store, übrigens. Beinahe hätte mich das dazu verführt, iPhone-Nutzer zu werden… Shazam war so beliebt, dass die Android-App ebenfalls eine der ersten im Playstore war. Jetzt war ich wirklich glücklich. Glücklicher wurden ein wenig später nur Apple-iPhone-User, weil die Shazam-Funktion in Siri integriert wurde. Und 2018 kaufte Apple Shazam dann auf. Was wieder einen Fortschritt brachte, denn die Shazam-App ist seitdem frei von Werbung – auch die Android-Version. Eine echte Alternative stellt übrigens auch die App Soundhound (gibt’s für Android und iOS) dar, die einen allerdings mit eingeblendeter Werbung nervt.

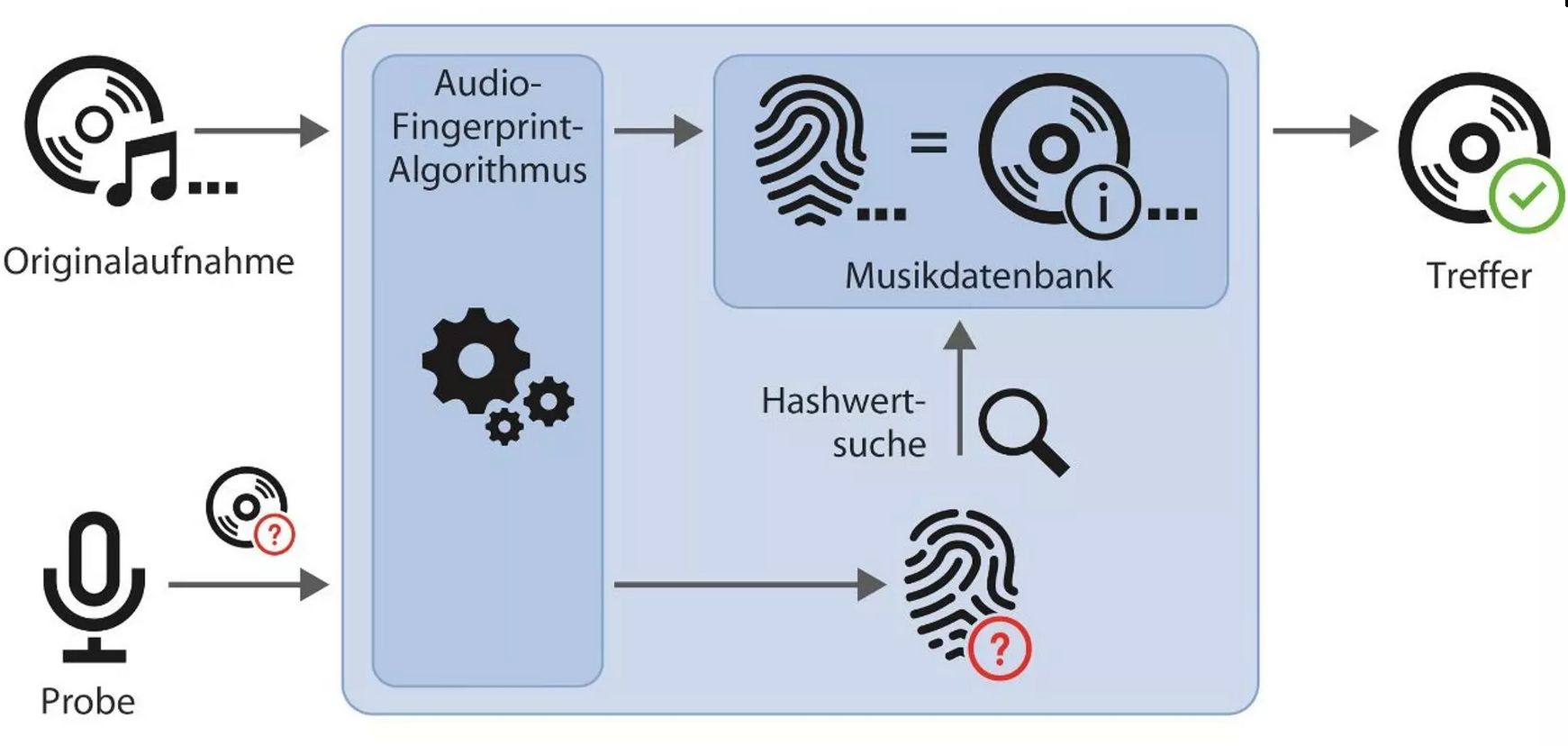

Aber, wie funktioniert eigentlich diese Musikerkennung? Wie schafft es Shazam, manche Titel schon nach weniger als 5(!) Sekunden zu erkennen? Die Grundidee ist es, aus jedem Song beziehungsweise Musikstück einen „Fingerabdruck“ zu destillieren, also ein Merkmal, dass das Lied eindeutig identifiziert. Dazu wird das gesamte Tonspektrum analysiert wird, also Faktoren wie Klangfarbe, Tempo, Instrumentierung etc. In einer Datenbank wird dann neben dem Titel und dem Interpreten auch dieser Fingerabdruck gespeichert. Wohlgemerkt: Der Fingerprint muss vorher erzeugt worden sein, das jeweilige System muss also zunächst mit Millionen von Songs gefüttert werden. Dieses Prinzip, nachdem alle Musikerkennungs-Apps arbeiten, haben die Shazam-Leute erfunden.

Dass Apple auf den Zug aufgesprungen ist, hat viel mit iTunes (damals) und Apple Music (heute) zu tun. Denn wenn man Millionen Songs auf den eigenen Servern gespeichert hat, damit Kunden sie herunterladen können, ist es ein Leichtes, diese zu analysieren, um die Fingerprints zu erzeugen. Übrigens: Shazam und Soundhound erkennen (manchmal) auch Songs, wenn du sie so gut wie’s geht ins Mikro singst oder summst. Und wenn sie deinen Karaoke-Versuch nicht identifizieren können, machen sie (meistens) sinnvolle Vorschläge, was es sein könnte.

Wenden wir uns der Google-Welt zu. Denn dort gibt es eine ähnliche eigene Funktion, die allerdings erst mit dem Smartphone Pixel 2 eingeführt wurde. Als Teil des Betriebssystems heißt sie „Now Playing„. Und weil Google ja gern mal mit den Namen Verwirrspiele betreibt, findet sich diese Funktion als App für Nicht-Pixel-Smartphones als „Pixel Ambient Services„. Sie macht genau dasselbe wie Shazam und funktioniert genauso gut. Mit dem Pixel 6 aber hat die Sache eine neue Qualität bekommen, die damit zusammenhängt, dass in der neuesten Generation Google-Smartphones eine TPU, ein Tensor-Chip eingebaut ist. Wir erinnern uns: Im Frühjahr 2016 sprach Google auf der I/O-Konferenz erstmals über die Sache, und wir Digisaurier wähnten Google damit auf dem Weg zur Weltherrschaft.

Die Googleaner waren so stolz auf die TPU, dass sie von einem Meilenstein beim maschinellen Lernen sprachen und öfter die Abkürzung „AI“ pro Minute aussprachen als Android-Versionen hat. Nun sind die beiden Modelle der Pixel-6-Generationen die ersten, in denen ein solches Wunderwerk Dienst tut. Ist das Smartphone eingeschaltet, lauscht das Ding auf alles, was der Nutzer tut und optimiert alle vom Betriebssystem kontrollierten Funktionen im Hinblick auf dessen Gewohnheiten. Beispiel: Otto Pixeluser reduziert jeden Abend im zehn Uhr die Display-Helligkeit. Spätestens nach einer Woche macht die TPU das für ihn.

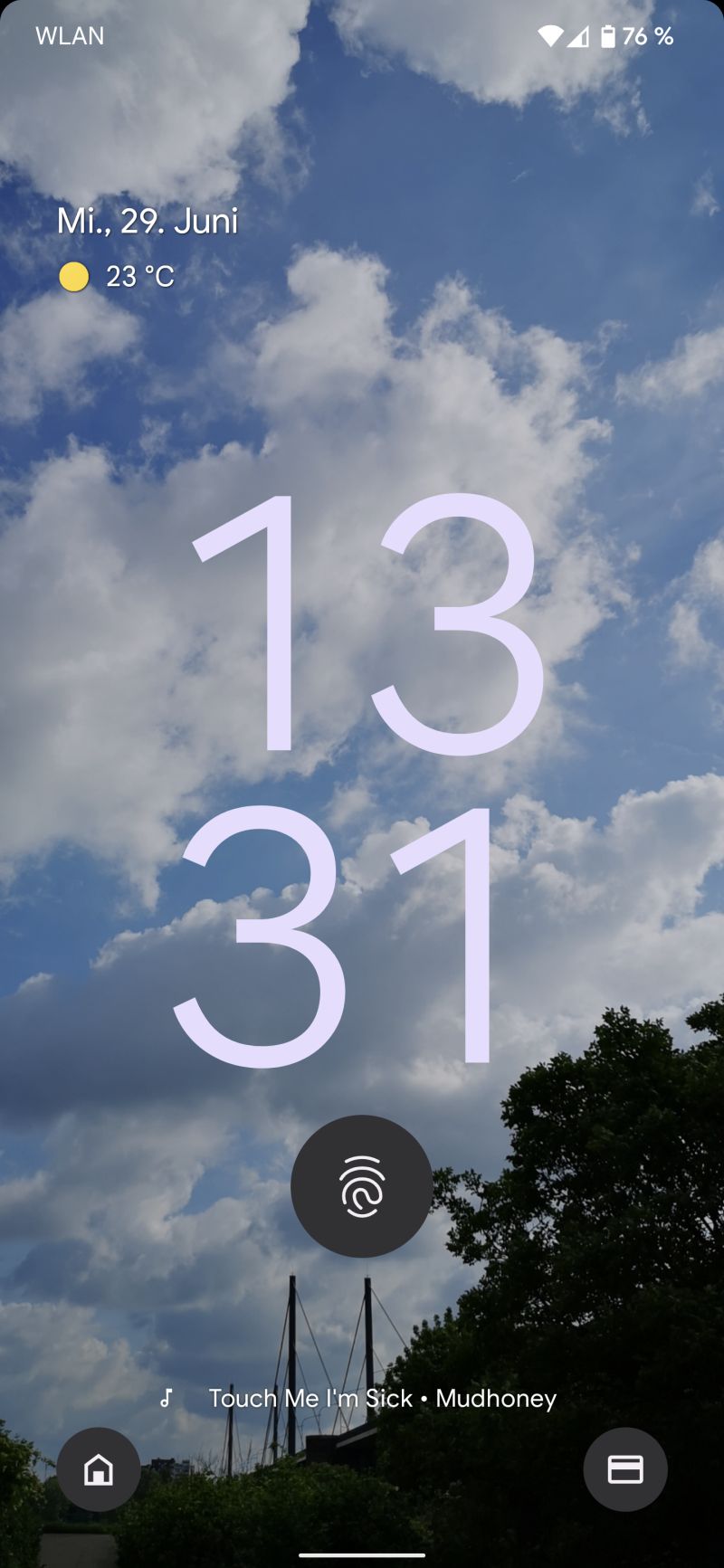

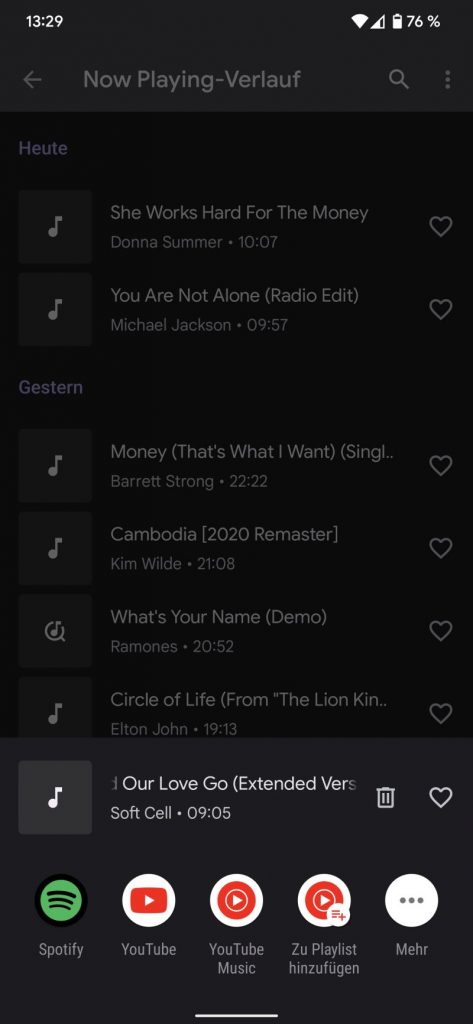

Weiter: Nach und nach lernt die Kamera-App dank Tensor, wie der Nutzer seine Fotos gern hätte und nimmt entsprechende Filterungen selbstständig vor. Übrigens sehr behutsam, und wenn der Knipser die Bilder dann selbst anders filtert, lernt die App das auch. Die Phone-App steckt voller kleiner Funktiönchen, die sich auf die „Intelligenz“ der TPU verlassen – wie beinahe alle anderen System-Apps auch. Womit wir bei „Now Playing“ sind, denn der KI-Chip macht möglich, was Shazam nicht einmal per Siri im iPhone kann: Es findet Songs per Fingerprint, ohne dazu eine Cloud bemühen zu müssen, denn die Datenbank steckt im Pixel-Smartphone selbst. So ist es möglich, das Handy ununterbrochen auch im ausgeschalteten Zustand auf Musik in der Umgebung lauschen und Songs erkennen zu können. Das bedeutet, dass du nicht ganz schnell die Shazam-App öffnen musst, wenn du ein Lied erkennen möchtest.

Die Ergebnisse werden jeweils kurz auf dem Sperrbildschirm angezeigt und im Now-Playing-Verlauf gespeichert. An meinem Pixel 6 Pro ist diese Funktion aktiviert, und manchmal ergibt das ganz lustige Sachen. Höre ich im Auto Musik, finde ich die Playlist natürlich fein säuberlich aufgezeichnet. Fährt jemand mit laut dröhnender Mucke an mir vorbei, erkennt mein Pixel-Phone auch, was der gerade hört. Und neulich sang eine Nachbarin auf dem Balkon einen aktuellen Hit mit, und – was soll ich sagen? – Now Playing erkannte auch den. Natürlich kann nur identifiziert werden, was einen Fingerprint in der Datenbank hat; OSTs von Filmen und Serien, die es nicht als einzelne Tracks gibt, können nicht erkannt werden.

Was kommt als nächstes? Klar, ein Device, das mit einer TPU ausgestattet ist, wird auch Bewegtbilder erkennen und identifizieren können, denn auch aus Videosequenzen lassen sich (mit deutlich mehr Aufwand) Fingerabdrücke destillieren, die dann zusammen mit den Daten des Clips gespeichert werden können. Beunruhigend ist lediglich, dass es auch deutlich mächtigere Tensor-Chips geben wird, die parallel geschaltet auch unvorstellbare große Mengen an Daten in Sekundenbruchteilen analysieren können … zum Beispiel Bilder von Überwachungskameras, in denen solche Maschinen dann Personen in Echtzeit identifizieren können. Schöne neue Welt…